Prepara tu empresa para aprovechar las oportunidades de la IA y reforzar tus políticas y principios de ciberseguridad, datos e IA.

- ¿Eres cliente de Gartner? Log in para obtener resultados de búsqueda personalizados

Prepárate para la IA: lo que todo responsable de TI debe saber y hacer

Las 4 iniciativas clave que prepararán tu empresa para la IA

Tanto si aspiras a que la IA potencie los procesos cotidianos como si esperas crear una solución revolucionaria, tu empresa necesita unas capacidades fundamentales para tener éxito.

Esta guía puede ayudar a los responsables de TI a preparar sus organizaciones para:

Definir sus “ambiciones de IA” y detectar las oportunidades de la IA.

Prepararse para la ciberseguridad de la IA.

Utilizar datos preparados para la IA.

Adoptar los principios de la IA.

Descarga tu ejemplar ahora.

Las ambiciones de IA deben sopesarse con la viabilidad, las oportunidades y los riesgos

Más del 60 % de los CIO afirman que la IA forma parte de su plan de innovación, pero menos de la mitad creen que la empresa pueda gestionar sus riesgos. Reduce la brecha: primero define tus ambiciones de IA.

- Las 3 áreas de ambiciones de IA

- Ambición de oportunidades de IA

- Implementación de la IA

- Riesgo de la IA

Define tus oportunidades, opciones de implementación y riesgos de la IA

Con la IA generativa, las máquinas han dejado de ser herramientas y se han convertido en compañeras de trabajo. Se trata de un gran cambio que conlleva una posible parte negativa. La alta dirección espera que los CIO lideren la estrategia de IA de la organización para poder aprovechar sus ventajas y evitar los riesgos.

Es mucho lo que está en juego, dada la combinación de entusiasmo y decepción que rodea a la IA en todas las organizaciones: decepción al ver que la mayoría de los proyectos de IA no se han implementado como estaba previsto.

Según la investigación de Gartner, entre el 17 % y el 25 % de las organizaciones tenían previsto implementar la IA dentro de los próximos 12 meses, todos los años desde 2019 hasta 2024, pero el crecimiento anual de las implementaciones de producción fue solo del 2 % al 5 %.

Para aumentar la tasa de éxito, los CIO deben empezar por ayudar a establecer las ambiciones de la organización en materia de IA, es decir, decidir dónde y cómo se utilizará la IA. Dado que la IA actual puede hacer cualquier cosa, como decidir, actuar, descubrir y generar, es muy importante saber lo que no vas a hacer.

Un plan de IA debe tener en cuenta tres elementos clave:

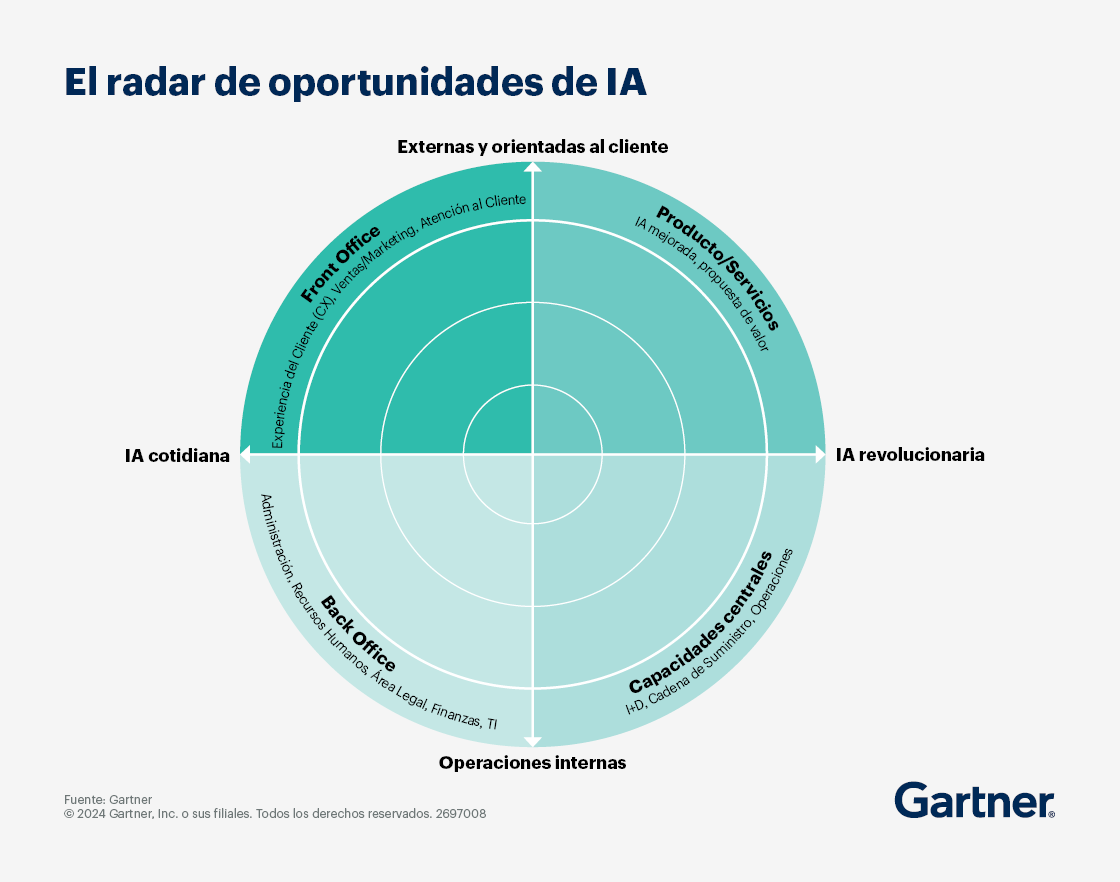

La ambición de oportunidades de IA

Este elemento refleja el tipo de beneficios empresariales que esperas obtener con la IA. La ambición de oportunidades identifica dónde utilizarás la IA (p. ej., para operaciones internas o actividades de cara al cliente) y cómo (p. ej., para optimizar las actividades cotidianas o para crear oportunidades revolucionarias). Aprovecha el radar de oportunidades de la IA de Gartner para planificar tu ambición de oportunidades.

La implementación de la IA

Este refleja las opciones tecnológicas disponibles para implementar la IA, que pueden posibilitar o limitar las oportunidades que esperas obtener. Las organizaciones pueden implementar la IA a partir de modelos públicos ya preparados y entrenados con datos de uso general; aprovechar un modelo público y adaptarlo con datos propios, o construir uno internamente como algoritmo personalizado, entrenado con datos propios. Cuanto mayor sea el nivel de personalización, mayores serán el coste de inversión y el tiempo de implementación, pero también su capacidad para ofrecer oportunidades revolucionarias.

El riesgo de la IA

El riesgo de la IA puede adoptar muchas formas, como resultados poco fiables u opacos, vulneraciones de propiedad intelectual o de privacidad de los datos, y ciberamenazas. También hay riesgos normativos emergentes relacionados con las reglas y restricciones que las distintas jurisdicciones pueden imponer a la IA, incluidas las relacionadas con los derechos de autor. Tu organización deberá definir su perfil de riesgo en relación con los niveles de automatización y transparencia.

Involucra al equipo ejecutivo para elegir qué oportunidades de IA perseguir

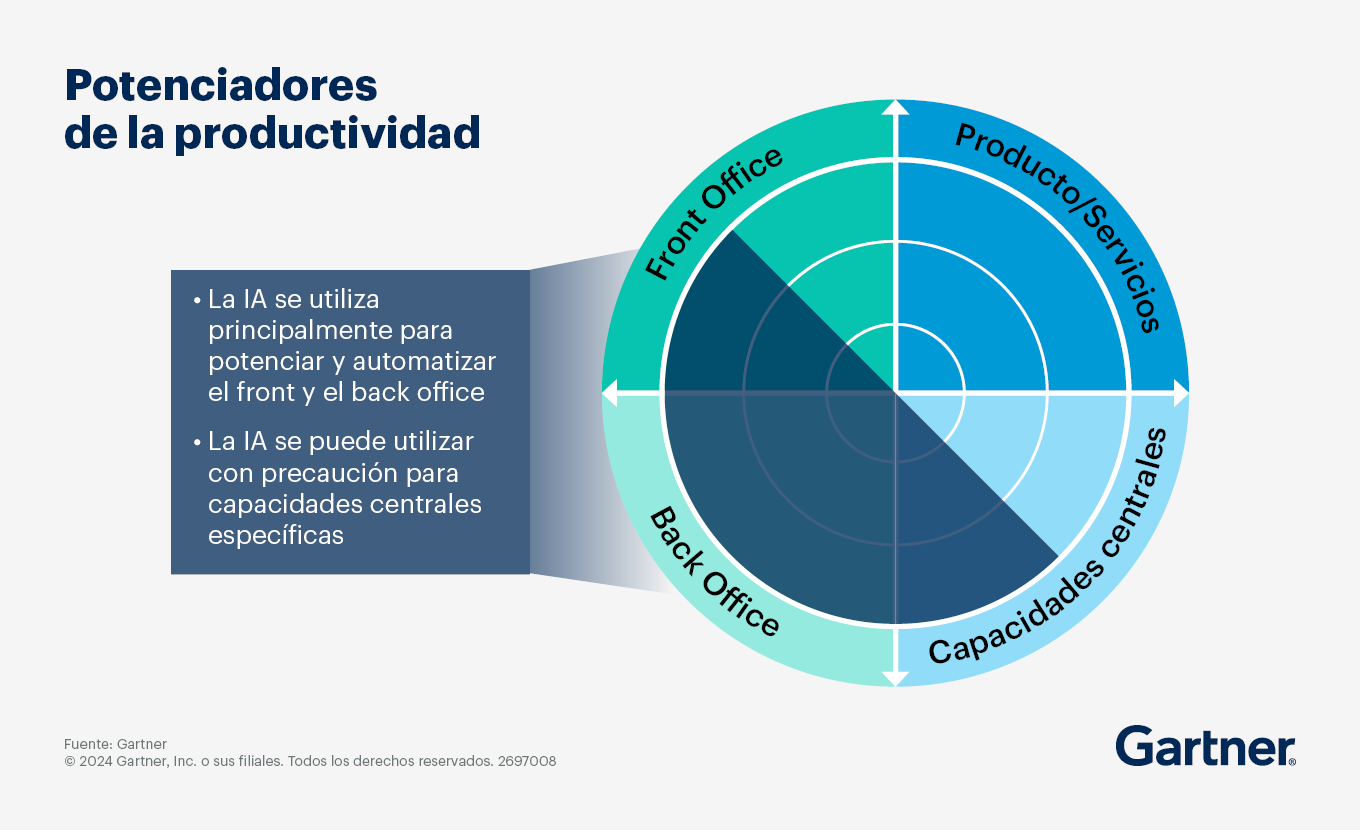

Dentro de la organización, se distinguen dos grandes categorías de IA:

- La IA cotidiana impulsa la productividad al capacitar a las personas para trabajar de manera más rápida y eficiente en tareas ya existentes.

- La IA revolucionaria impulsa la creatividad al permitirte generar resultados a través de nuevos productos y servicios, o mediante nuevas capacidades centrales. La IA revolucionaria provocará cambios disruptivos en los sectores y los modelos de negocio.

Tanto la IA cotidiana como la IA revolucionaria permiten usos internos y externos. Definir tus ambiciones de IA implica examinar qué combinaciones de IA cotidiana e IA revolucionaria y qué casos de uso interno o externo perseguirás.

Las expectativas de inversión influirán en estas decisiones, dado que la IA revolucionaria no es económica. Aunque el 73 % de los CIO declaran que prevén invertir más en IA en 2024 que en 2023, los CFO se muestran escépticos acerca de los resultados: el 67 % de los responsables financieros aseguran que las inversiones digitales han rendido menos de lo esperado.

Para definir unas ambiciones de IA realistas, evalúa tres escenarios de inversión en IA con tu equipo directivo:

Defender la situación actual invirtiendo en victorias rápidas que mejoren tareas específicas. Las herramientas de IA cotidiana tienen un coste de adopción bajo, pero no aportarán una ventaja competitiva sostenible a tu organización. Invertir según este escenario te permite mantener el statu quo.

Ampliar la situación actual invirtiendo en aplicaciones personalizadas que ofrezcan una ventaja competitiva. Estas inversiones en IA son más costosas y tardan más tiempo en materializarse, pero también son más valiosas.

Dar un giro a la situación actual creando nuevos productos y modelos de negocio impulsados por la IA. Estas inversiones son muy costosas, arriesgadas y requieren de mucho tiempo, pero ofrecen grandes recompensas y pueden revolucionar tu sector.

Por último, cuando los CIO involucren a los ejecutivos de la empresa en su ambición de oportunidades de IA, deben asegurarse de tener un conocimiento preciso sobre la viabilidad. Así, por ejemplo, no es posible captar oportunidades sin la tecnología necesaria. Tampoco se puede implementar la IA cuando las personas que la utilizarán, interna y externamente, no están preparadas para hacerlo.

El radar de oportunidades de IA de Gartner (rellena el formulario anterior para obtener más detalles) presenta las ambiciones de IA en términos tanto de oportunidades como de viabilidad.

Ten en cuenta que las mayores oportunidades probablemente sean innovaciones disruptivas, capaces de provocar un giro radical en un sector y ofrecer grandes beneficios económicos, pero su viabilidad es baja porque implican tecnología no probada o por falta de voluntad de las partes interesadas.

Comprende las opciones de implementación de la IA y las contrapartidas en términos de velocidad y diferenciación

En los últimos seis meses, se han lanzado al mercado innumerables modelos y herramientas de IA. Además, muchos de los grandes proveedores de software independientes (ISV, por sus siglas en inglés) están incorporando la IA en sus aplicaciones existentes. Este tipo de competencia es habitual en la mayoría de los mercados de alto riesgo y en fase inicial, y crea una confusa variedad de opciones.

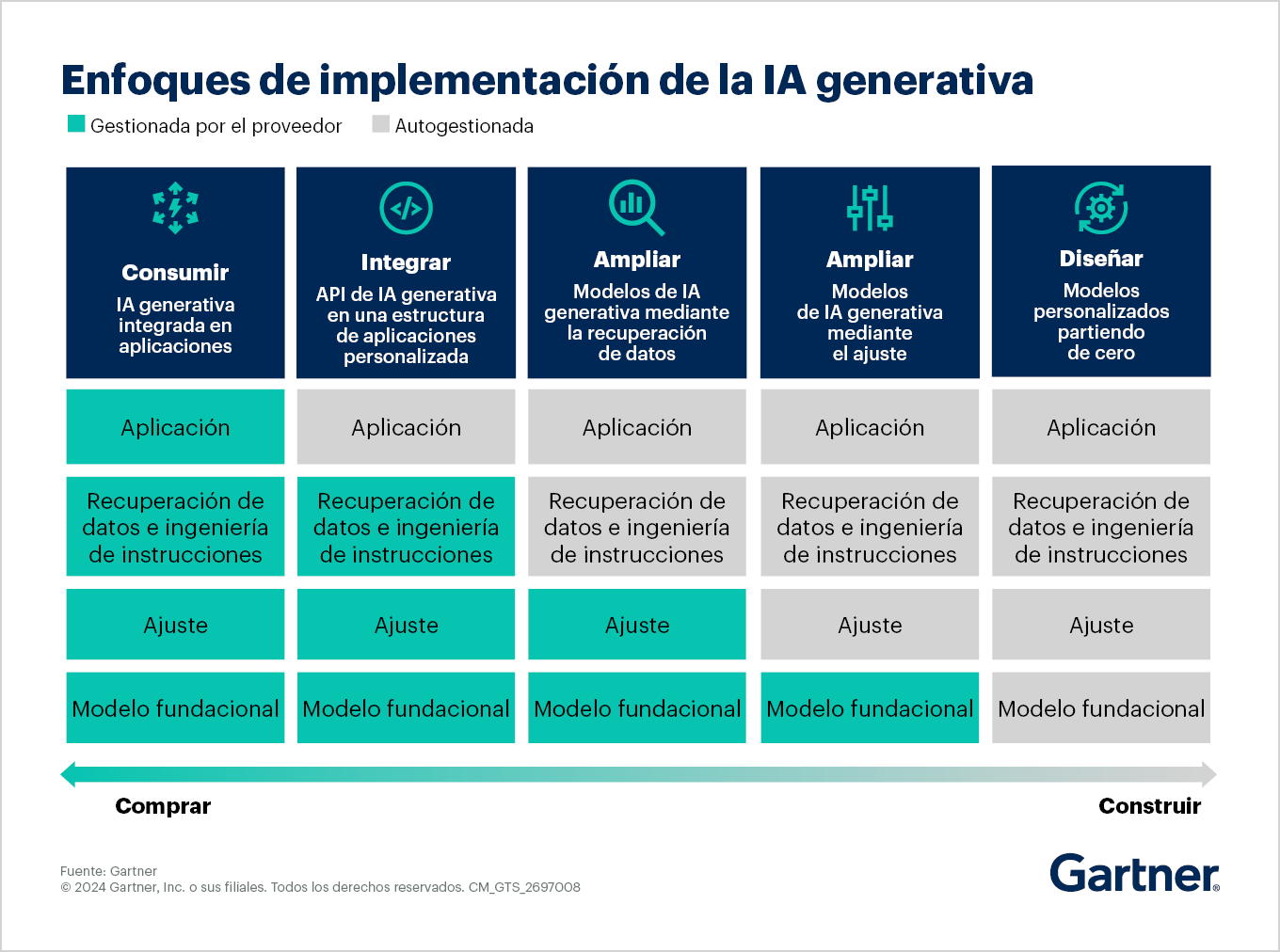

Partiendo del ejemplo de la IA generativa, Gartner identifica cinco enfoques emergentes en la implementación de la IA:

Consumir IA generativa integrada en aplicaciones, por ejemplo, utilizar una aplicación de software de diseño consolidada que empiece a incluir capacidades de generación de imágenes (como Adobe Firefly).

Integrar las API de IA generativa en una estructura de aplicaciones personalizada de modo que las empresas puedan crear sus propias aplicaciones e incorporarles la IA generativa a través de API de modelos fundacionales.

Ampliar los modelos de IA generativa a través de la recuperación de datos, por ejemplo, utilizando la generación mejorada por recuperación (RAG, por sus siglas en inglés), que permite a las empresas recuperar datos obtenidos de fuentes externas al modelo fundacional (a menudo los propios datos de la empresa) y mejorar la precisión y la calidad de la respuesta del modelo en tareas específicas del dominio.

Ampliar los modelos de IA generativa mediante el ajuste de grandes modelos fundacionales entrenados previamente, utilizando datos nuevos para incorporar conocimientos adicionales del dominio o mejorar el rendimiento en tareas específicas. Esto suele dar lugar a modelos personalizados que son específicos de la organización.

Diseñar modelos fundacionales personalizados partiendo de cero y adaptarlos completamente con los datos y dominios empresariales propios.

Cada enfoque de implementación conlleva contrapartidas entre ventajas y riesgos. Los factores clave que influyen en estas contrapartidas son:

Costes: las aplicaciones integradas y las API de modelos integrados son las opciones más económicas de implementación de la IA. Construir un modelo partiendo de cero sería la más cara. Entre ambas, los costes varían mucho, especialmente si se opta por el ajuste en que los costes son altos cuando se actualizan modelos con miles de millones de parámetros.

Conocimiento organizativo y del dominio: la mayoría de los modelos fundacionales de IA son modelos de conocimiento general. Para mejorar la precisión, las organizaciones deben aportar especificidad en términos de dominio y de casos de uso mediante recuperación de datos, ajuste o construcción de un modelo propio.

Capacidad para controlar la seguridad y la privacidad: las consideraciones en torno a la seguridad y la privacidad son bastante amplias actualmente en el caso de la IA generativa. Construir modelos propios o crear modelos personalizados mediante un proceso de reajuste asegura una propiedad más sólida de los activos clave y mayor flexibilidad en cuanto a los controles que es posible implementar.

Control de los resultados del modelo: los modelos fundacionales de IA son propensos a los riesgos de alucinación, así como a propagar comportamientos sesgados o perjudiciales. La recuperación de datos, el ajuste del modelo y la construcción de modelos propios pueden ser preferibles en entornos de alto control. Las aplicaciones esenciales para el negocio requerirán la intervención humana.

Simplicidad de implementación: el consumo de aplicaciones integradas y la integración de API de modelos tienen ventajas debido a su simplicidad inherente y al tiempo de comercialización. No tienen un impacto negativo significativo en los flujos de trabajo actuales.

Define la tolerancia al riesgo de la IA de cada departamento o unidad de negocio

Concluir qué oportunidades de IA perseguirá la organización exige a los responsables de empresa articular el nivel de riesgo que están dispuestos a aceptar en relación con problemas como la fiabilidad, la privacidad, la explicabilidad y la seguridad de la IA:

Fiabilidad de la IA

Dependiendo de cómo se entrene, toda IA puede ser vulnerable en cierto grado a:

Imprecisiones fácticas o resultados parcialmente verdaderos, con errores en detalles importantes.

Alucinaciones o resultados inventados.

Información obsoleta debido al conocimiento limitado en los datos de entrenamiento.

Información sesgada en los datos de entrenamiento, que da lugar a resultados sesgados.

Privacidad de la IA

Los problemas de privacidad van desde la preocupación por la información identificable en los datos de entrenamiento hasta la divulgación de datos o resultados, lo que incluye:

Revelación de información del usuario a terceros sin previo aviso, incluidos vendedores o proveedores de servicios, filiales y otros usuarios.

Tratamiento de datos (re)identificables.

Entrenamiento con datos (re)identificables que pueden tener un impacto en el mundo real una vez en producción.

Filtración involuntaria de datos confidenciales o personales.

La información de propiedad, sensible o confidencial que se introduce como instrucción o para la recuperación de datos podría incluirse en la base de conocimientos utilizada para los resultados de otros usuarios.

Explicabilidad de la IA

Los modelos de machine learning (ML) son poco transparentes para los usuarios y, en ocasiones, incluso para los profesionales expertos. Aunque los científicos de datos y los desarrolladores de modelos entienden lo que intentan hacer sus modelos de ML, no pueden descifrar la estructura interna ni los medios algorítmicos por los que los modelos procesan los datos. Esta falta de comprensión del modelo y, por tanto, de explicabilidad, que Gartner define como las capacidades que aclaran el funcionamiento de un modelo, limita la habilidad de una organización para gestionar el riesgo de la IA. La ausencia de explicabilidad hace que los resultados de un modelo sean:

Impredecibles

No verificables

No responsabilizables

Seguridad de la IA

La IA puede ser un nuevo objetivo para los agentes maliciosos que buscan acceder a datos privados o manipular el comportamiento de la IA en beneficio propio. A modo de ejemplo:

Hackers que acceden a información personal o sensible almacenada por un modelo de IA.

Hackers que introducen instrucciones para manipular un gran modelo de lenguaje (LLM, por sus siglas en inglés) con el fin de que produzca información que no debería.

LLM que son engañados para escribir código de malware o ransomware.

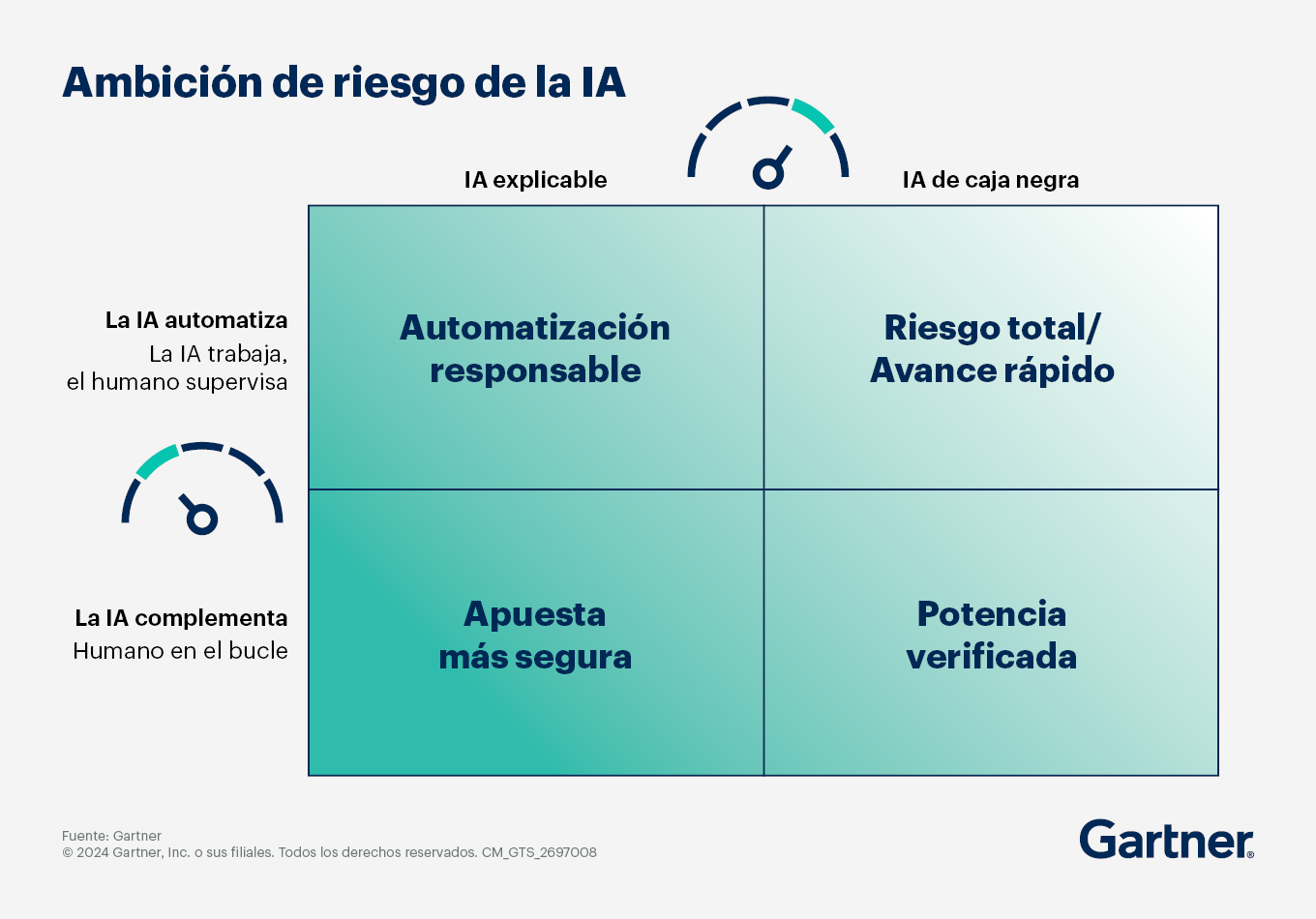

Trabaja con los directores ejecutivos para definir su ambición de riesgo

Para equilibrar los riesgos de la IA con las oportunidades a las que aspira la organización, los CIO deben ayudar a definir los puestos que corresponden a los humanos y los que corresponden a la IA. El objetivo es lograr el equilibrio entre el grado de automatización (desde la automatización absoluta hasta “el humano en el bucle”) y la explicabilidad (desde una IA de “caja negra” totalmente opaca hasta una totalmente explicable).

Cada director de experiencia (CxO) debe establecer sus niveles aceptables de riesgo de la IA para los principales procesos de sus departamentos y alinearlos con las oportunidades que espera aprovechar. A modo de ejemplo, el responsable de RR. HH. podría tener un nivel de tolerancia al riesgo enfocado a la “apuesta más segura” debido a la naturaleza sensible de su trabajo, mientras que el de Atención al Cliente podría aspirar a la “automatización responsable” para permitir una automatización que pueda explicarse a los clientes, si es necesario.

Disfruta de las conferencias de Information Technology

Súmate a otros profesionales del sector en la presentación de las últimas tendencias en las conferencias de Gartner.

Gartner CIO & IT Executive Conference

São Paulo, Brasil